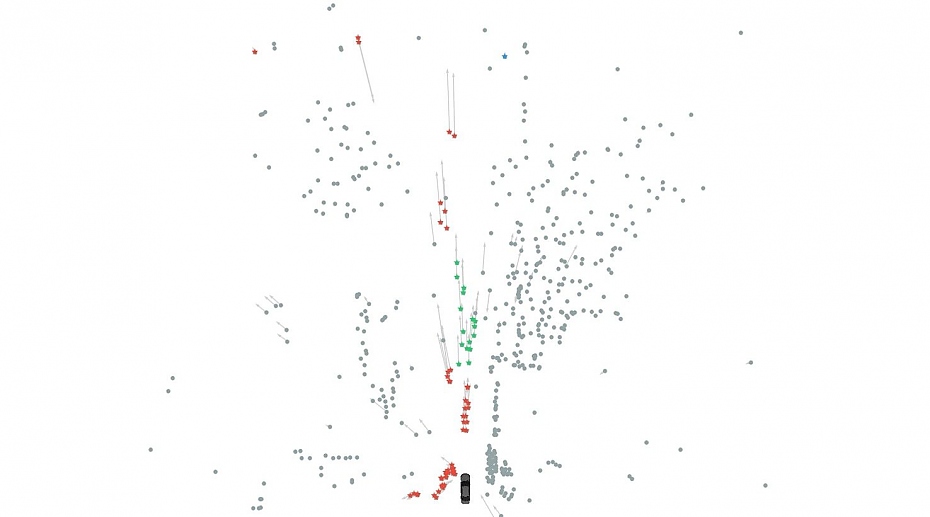

Damit das klappt, muss auch der gute alte Radarsensor weit mehr leisten, als bisher. "Beim, Radar findet ein Paradigmenwechsel statt. Weg vom Erkennen, dass da was ist, hin zum was es genau ist", sagt Dr. Markus Hahn. So misst der Sensor auch Reflexe und schaut unter Autos durch. Anhand der Achsen und der Radkästen erkennt das System, dass es sich um ein Auto oder einen Lkw handelt und nicht um einen Radfahrer. In einem Bild sind hundert Million klassifizierte Radarreflektionen. Deswegen erkennen die Radarsensoren auch Fußgänger, die sich in einer Entfernung von bis zu 90 Metern befinden. Ohne den Homo Sapiens, also ohne menschliche Hilfe geht das natürlich nicht. Beim Konzept des "Deep Learnings" wird dem Computer, wie einem Kind beigebracht, wie die verschiedenen Pixelhaufen beziehungsweise Daten zu interpretieren sind. Die Idee, dass autonome Autos per se selbst lernen werden, verweisen die Entwickler übrigens ins Reich der Fabel: "Dann hätte ja jedes Fahrzeug einen unterschiedlichen Software- beziehungsweise Wissensstand und wir bekommen die Meute nicht mehr eingefangen", macht Dr. Uwe Franke, der sich bei Mercedes mit dem autonomen Fahren beschäftigt, klar. Deswegen kann so ein "Update" zunächst nur über einen zentralen Server an alle selbstständig agierenden Fahrzeuge vorgenommen werden. Irgendwann werden die Autos miteinander kommunizieren, um wie eine Schwarmintelligenz voneinander profitieren.

Exakte Umsetzung nötig

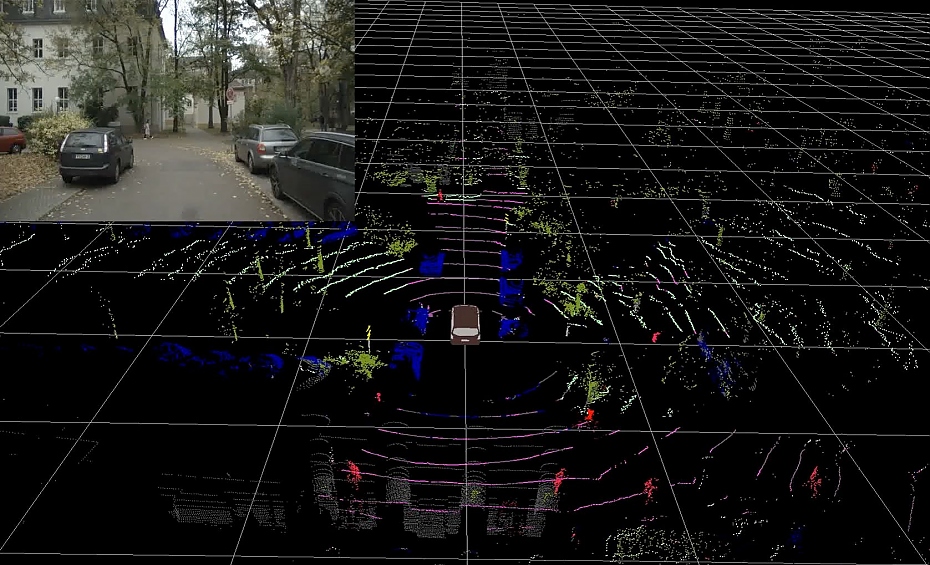

Ergänzt werden diese Daten durch die Ergebnisse des Lidar-Sensors (Light Detection and Ranging / Lichterkennung und Entfernungsmessung), der einen Winkel von 360 Grad abdeckt. auch bei diesem Sensor versuchen die Software-Tüftler aus jedem Bildpunkt das Optimum heraus zu kitzeln. "Wir messen Distanzen und Intensitäten", erklärt Lidar-Fachmann Philipp Lehner. Zum Beispiel reflektiert ein Verkehrsschild das Lidar-Signal deutlich intensiver, als etwa ein schwarzes Auto. Damit leistet auch dieser-Sensor weit mehr als nur eine simple Darstellung des Ist-Zustands, und zwar eine Entschlüsselung einer dreidimensionalen Punktewolke zum Verständnis einer Szene. Die Techniker bezeichnen das als "Semantische Punktewolke", in der jeder Punkt seine Klassifizierung hat, also: Weg, Auto, Straße, Mensch. Da der Lidar-Sensor zentimetergenau die Entfernung misst, hilft dies auch bei der Erkennung einer Bewegung. Mit dieser ganzen Sensoren-Armada, zu der auch Kameras gehören, sollen die Robo-Autos der Zukunft Fußgänger und andere Verkehrsteilnehmer so lange es geht verfolgen, um dann sicher und vorausschauend zu agieren.

Damit der Computer auch versteht, ist eine sehr leistungsfähige Soft- und Hardware nötig. Die Rechenleistung entspricht in etwa der von sechs High-End-Gaming PCs. Dass beim autonomen Fahren präzise Fahrmanöver, die auch unter widrigen Bedingungen, wie zum Beispiel schlechte Straßen oder Seitenwind, unabdingbar sind, wird oft übersehen. Die Anweisungen des künstlichen Gehirns können noch so gut sein, wenn das Robo-Auto sie nicht exakt umsetzt, können die Auswirkungen fatal sein.

Fotos: press-inform / Mercedes

- Details

- Geschrieben von wolfgang-gomoll

- Veröffentlicht: 18. Juli 2018